챗GPT가 출시된 지 2년, 학계가 겪은 급격한 변화를 네이처가 심층 분석했다. 와일리Wiley 출판사가 실시한 1,043명의 연구자 설문에서 드러난 81%라는 놀라운 사용률은 AI가 이미 연구 현장의 필수 도구가 되었음을 입증한다. 더욱 주목할 점은 연구자의 75%가 향후 5년 내 AI 기술이 필수가 될 것으로 전망했다는 사실이다.

스탠퍼드 대학교의 AI 연구원 제임스 조우James Zou는 “이전의 AI 글쓰기 도우미와는 차원이 다른 변화”라고 평가했다. 실제로 2023년 한 해 동안 최소 6만 편의 학술 논문이 대규모 언어 모델(LLM)의 도움을 받아 작성되었으며, 이는 전체 논문의 1% 이상을 차지한다.

분야별로는 뚜렷한 차이를 보인다. 2024년 상반기 기준, 생물의학 분야에서는 논문 초록의 최소 10%가 LLM을 활용한 반면, 컴퓨터 과학 분야에서는 17.5%로 더 높은 비율을 기록했다. AI 컨퍼런스의 경우 더욱 두드러져, 2023년과 2024년 제출된 동료 심사의 6.5-16.9%가 LLM에 의해 생성된 것으로 추정된다.

HTW 베를린 응용과학대학교의 데보라 베버-울프Debora Weber-Wulff는 이러한 수치들이 오히려 보수적인 추정치일 수 있다고 경고한다. 현재의 감지 도구들이 AI 작성 텍스트를 효과적으로 식별하지 못하고 있다는 것이다.

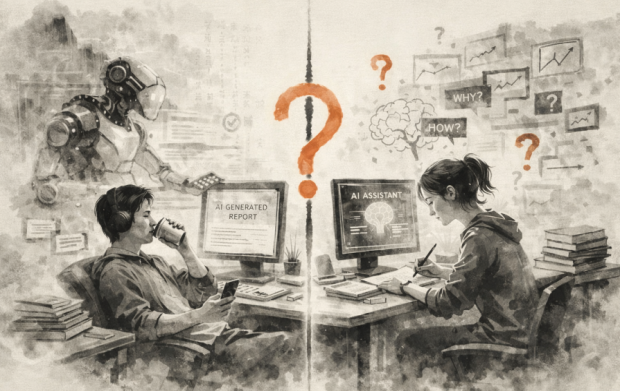

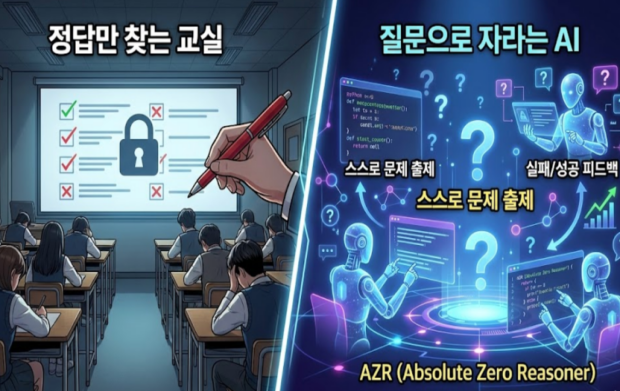

콜로라도 대학교 의과대학 오로라 캠퍼스의 의료정보학자 밀턴 피비도리Milton Pividori는 “우리의 시간을 들일 가치가 있는 것은 어려운 질문들과 창의적인 가설들”이라며, AI 활용의 본질적 방향성을 제시했다.

그러나 이러한 급속한 변화는 심각한 우려도 동반한다. 연구 논문의 부정확성, 표절 가능성, 높은 에너지 소비 등이 주요 문제로 지적된다. 특히 AI 작성 텍스트 감지의 한계는 학술적 진실성 검증에 큰 도전이 되고 있다.

오픈AI가 개발한 챗GPT의 혁신적 성과는 학계의 연구 방식을 근본적으로 재편하고 있다. 이는 연구의 효율성을 높이는 동시에 학문적 진실성과 창의성의 보존이라는 새로운 과제를 제시한다. 결국 AI 기술의 발전이 가져온 혜택을 누리면서도, 학술 연구의 본질을 지켜낼 수 있는 제도적, 기술적 장치 마련이 시급한 시점이다.

이러한 변화는 단순한 도구의 도입을 넘어 학술 연구의 패러다임 전환을 의미한다. 앞으로 AI와 인간 연구자의 협력 방식, 연구 윤리의 재정립, 그리고 학술적 진실성 검증 방법 등에 대한 깊이 있는 논의가 필요할 것으로 보인다.

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.