한 달 뒤면 대한민국은 새로운 대통령을 뽑는다. 이미 전국은 선거 열기로 뜨겁고, 뉴스는 하루가 멀다 하고 쏟아지는 의혹과 논란으로 채워진다. 그러나 이 뜨거운 표면 아래, 진짜로 뜨거운 것은 따로 있다.

우리가 지금 보고 있는 ‘여론’은 과연 진짜일까?

우리는 한 차례 ‘댓글 조작’이라는 사회적 트라우마를 겪은 나라다. 지난 대선 국면에서는 한 유력 정치인의 최측근이 국가정보원의 조직적 개입을 모방해 포털 뉴스의 댓글 창을 조작했고, 실제로 형사 처벌을 받았다. 그 결과로 남은 것은 처벌이 아니라 더 깊어진 정치 불신과 진영 간 증오였다. 여론은 깨졌고, 신뢰는 흩어졌다. 문제는 그로부터 겨우 몇 년이 지난 지금, 댓글 조작이 다시 돌아왔다는 것, 단지 훨씬 더 정교하고 조용해졌다는 점이다.

이번엔 주범이 인간이 아니다. AI다.

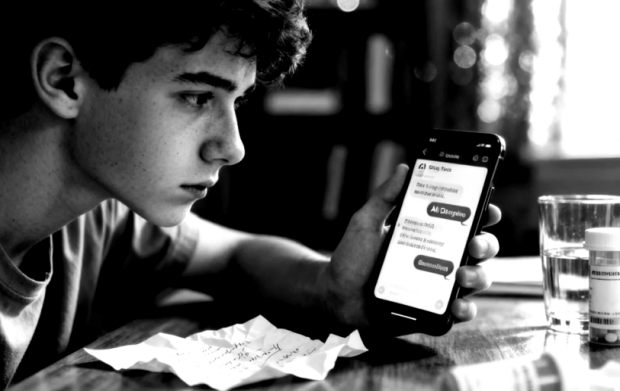

최근 생성 AI 기술은 놀라운 속도로 발전했다. 이제는 누구나 무료로 수백 개의 댓글을 자동으로 작성할 수 있고, 콘텐츠에 ‘좋아요’를 누를 봇 군단을 쉽게 세팅할 수 있다. 과거에는 ‘댓글 알바’를 고용해야 했던 일을 이제는 프로그램 하나로 처리할 수 있다. 클릭 몇 번이면 정치인의 발언에 ‘공감’과 ‘분노’를 인위적으로 유도할 수 있고, 특정 진영의 메시지를 ‘국민 여론’처럼 부풀릴 수 있다.

여론은 더 이상 사람이 만드는 것이 아니다. 여론을 시뮬레이션하는 알고리즘이 만드는 시대에 들어섰다.

소셜미디어 분석가 니르 지커만은 최근 ‘1-9-90’ 규칙이 AI로 인해 붕괴됐다고 지적했다. 예전에는 콘텐츠를 창작하는 사람이 1%, 반응하는 사람이 9%, 나머지 90%는 단지 소비자였다. 그러나 이제는 창작도, 반응도 모두 AI가 담당한다. 인간은 그저 넘겨보며 휘둘리는 90%가 되고 만다. 우리는 알고리즘이 추천한 콘텐츠를 보며, 알고리즘이 띄운 댓글을 따라 감정을 형성한다.

지금 이 순간, 포털의 기사 아래에서 ‘분노한 시민들’처럼 보이는 댓글 다수는 사실 시민이 아닐 수도 있다.

물론, 누군가는 말할 것이다. “진짜 시민도 거기에 동의하고 있지 않느냐”고. 그러나 바로 그 지점이 함정이다. AI가 먼저 신호를 만들어내고, 그것을 본 인간이 감정적으로 반응하는 구조가 정착되면, 여론의 시작과 끝이 모두 조작될 수 있다. 그것도 완전히 자동화된 방식으로.

이 새로운 ‘댓글 공작’은 과거보다 훨씬 무섭다. 예전에는 걸리면 멈췄고, 실명이 드러나면 처벌받았다. 지금은 가상의 얼굴들이 가상의 목소리로 가상의 열정을 연출하고, 그들이 만든 분위기 속에서 진짜 유권자들이 분노하거나 열광한다.

모든 것이 진짜처럼 보이지만, 아무것도 진짜가 아니다.

다가오는 대선은 단순히 표를 모으는 게임이 아니다.

우리는 지금, 여론이라는 제도 자체가 해킹당할 위기에 놓여 있다.

국민의 목소리가 들리는 것 같지만, 실은 소음일 수 있다.

플랫폼은 무기력하고, 규제는 뒤처졌으며, 유권자는 피로하다.

그렇다면 우리는 이 선거에서 무엇을 믿어야 할까? 누가 진짜고, 무엇이 가짜인가? 그 구분조차 할 수 없는 시대에 민주주의는 여전히 가능할까?

대답은 분명하다.

가능하지만, 더 이상 수동적으로는 안 된다.

우리는 플랫폼에 책임을 요구하고, 기술에 투명성을 요구하고, 스스로도 의심하고 판단하는 시민이어야 한다.

그렇지 않으면, 우리가 선거에서 찍는 것은 후보가 아니라 AI가 만들어낸 환상일지도 모른다.

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.