Wayne Holmes,

1 UCL 교육 연구소, 런던 대학교, 런던, 영국

2 유네스코 후원 AI 국제 연구 센터, 슬로베니아 류블랴나

** 이 글은 프론티어에 실린 <AI, education, and children’s rights>를 구글 AI로 번역하였습니다.

인공지능(AI) 시스템은 교육 분야에서 점점 더 많이 활용되고 있습니다. 그러나 이러한 AI 시스템이 아동 권리에 미치는 영향은 대부분 간과되고 있습니다. 본 논문은 이러한 누락에 대한 논의를 심화하고자 합니다. 먼저 AI가 다른 디지털 기술과 어떻게 다른지(인간 행동을 모방하는 것이 AI의 능력에 대한 오해로 이어지기 때문)를 살펴본 후, 아동의 핵심 권리인 교육, 존엄성, 자율성, 사생활 보호, 차별 및 경제적 착취로부터의 보호에 대한 권리를 명시한 유엔 아동 권리 협약(UNCRC)을 소개합니다. 이어서 이러한 각 권리를 AI 시스템이 어떻게 상황을 복잡하게 만드는지에 초점을 맞춰 살펴봅니다. 예를 들어, AI 시스템은 인간 교사의 공감 능력과 직관력이 부족하여 아동의 존엄성을 훼손할 위험이 있습니다. 또한 상업적 AI 개발자가 아동의 데이터를 악용하는 것은 아동이 무급 노동을 하는 것과 같습니다. 본 논문은 AI가 아동의 인지 발달과 권리에 미치는 영향을 이해하기 위해서는 더 많은 윤리적 연구가 필요하다고 주장하며 결론을 내립니다. 정책 입안자, 교육자, 개발자는 AI의 논란이 되는 이점보다 아동의 권리와 복지를 우선시해야 하며, 이를 통해 아동 권리 원칙과 완전히 일치하도록 해야 합니다.

소개

인공 지능(AI)은 어린이의 교육에 대한 권리를 다루고 교육 경험을 향상시키는 ‘강력한’ 도구로 자주 제안됩니다.단지 한 가지 예를 들자면, AI는 “개인화되고 매력적인 학습 경험을 제공하고 교사의 업무량을 보다 의미 있는 작업으로 전환하며 학교에서 가르치는 방법과 내용을 바꿀 수 있는 잠재력이 있다”고 합니다 ( OECD, 2023 ).그러나 이러한 주장을 뒷받침할 만한 규모 있는 독립적인 증거는 아직 없습니다.사용 가능한 증거는 일화적(즉, 소규모 사례에 기반함), 추측적(증거가 없는 ‘잠재력’은 약함)이거나 논쟁의 여지가 있는 가정(예: 교육은 모두 ‘학습’에 관한 것이고 ‘개인화된 학습’은 가치가 있음)에 기반합니다.어쨌든 AI의 부정적인 ‘잠재력’은 대부분 무시됩니다(예: 인지 및 비판적 역량, 행위 및 자기 효능감, 환경 및 인권에 미치는 영향, Holmes et al., 2022 ; Holmes, 2023 ). ‘윤리’에 대한 단순한 이야기가 종종 있는데, 대개 ‘편견’이라는 말로 구체화되지만 그 이상은 거의 언급되지 않습니다.

AI는 교육 접근성을 보장하는 ‘해결책’으로 자주 제시되지만(예: Seldon and Abidoye, 2018 ), 그 함의는 복잡하고 다면적입니다. 실제로 여러 국제 기관에서 AI가 교육에 미치는 영향을 검토해 왔습니다(예: EU의 AI법,1 유네스코 인공지능 윤리에 관한 권고안,2 및 OECD의 인공지능이 교육의 형평성과 포용성에 미치는 잠재적 영향).3 그러나 AI 시스템이 아동 권리에 미치는 부정적, 그리고 종종 숨겨진 영향은 거의 명시적으로 고려되지 않습니다. 앞서 언급한 세 국제 출판물은 AI가 아동 권리에 미치는 영향에 대해 언급은 했지만 자세히 설명하지는 않았습니다. 유니세프는 아동을 위한 AI 정책 지침에서 이러한 영향을 검토했습니다.4 (2021)에 언급된 내용이지만, 이 글은 생성 AI(Generative AI)가 대중화되기 전(2022년 ChatGPT 출시)에 작성되었으며, 당시에는 교육 분야에서 AI의 ‘잠재력’에 대한 주장이 거의 제기되지 않았습니다. 그럼에도 불구하고, 본 논문은 유니세프 문서에서 시작된 논의를 확장하고자 합니다.

그러나 AI가 일부 핵심 아동 권리에 미치는 영향을 살펴보기 전에 AI가 단순히 ‘또 다른’ 디지털 기술이 아니라는 점을 먼저 기억하는 것이 유용합니다. AI 시스템은 인간의 행동, 의사소통, 의사 결정 과정을 효과적으로 모방하는 최초이자 유일한 기술입니다. AI 시스템은 인간과 유사한 것으로 판매되고, 인간처럼 보이고, 인간과 유사한 것으로 인식되어 종종 인간과 유사한 의도, 능력, 이해력으로 작동한다는 오해를 불러일으키지만, 실제로는 그렇지 않습니다. AI는 단순한 기술이 아니라 사회 기술적 조합입니다. 다시 말해, 우리가 AI라고 부르는 것은 기술적 구성 요소와 사회적 구성 요소를 모두 통합한 복잡한 시스템입니다. 사회적 구성 요소에는 AI를 설계하고 사용하고 영향을 받는 사람과 조직적, 정치적, 경제적 구조, 그리고 개발, 배포, 영향을 형성하는 사회적, 윤리적 규범이 포함됩니다( Davies et al., 2021 ).

아동 권리

1989년(세계인권선언 40주년)5 유엔 아동 권리 협약(UNCRC)6. 아동 보호를 위한 포괄적인 틀을 확립하고, 미성숙하고 발달하는 신체적, 인지적, 정서적 능력을 가진 개인으로서 아동의 고유한 요구를 인정합니다. 유엔 아동권리협약에 명시된 주요 권리에는 아동의 양도 불가능한 교육권(제28조 및 제29조), 차별로부터의 보호권(제2조), 존엄권(서문, 제23조, 제28.2조, 제37조, 제39조, 제40조), 자율권(모든 조항), 청렴권(제12조 및 제13조), 사생활권(제16조), 그리고 경제적 착취로부터의 보호권(제32조)이 있습니다. 아동 권리의 보호와 증진은 아동이 신체적, 인지적, 정서적 발달에 필요한 자원과 지원에 접근할 수 있도록 보장하는 근본적인 권리이며, 교육은 이러한 권리 실현에 중추적인 역할을 한다는 것이 널리 인정되고 있습니다. 교육은 다른 인권을 충분히 누릴 때는 증진시키는 승수 역할을 하지만, 그렇지 않을 때는 다른 인권에 부정적인 영향을 미칩니다.

그러나 아동 권리는 복잡한 문제 없이 해결될 수 없습니다. 예를 들어, 맥락을 벗어난 접근 방식은 아동이 성장하는 다양한 생활 환경과 사회적, 경제적, 역사적 맥락, 그리고 개별 아동(특히 연령, 성별, 지리적 위치, 종교적 소속, 사회경제적 지위가 다른 아동) 간의 엄청난 다양성을 간과할 수 있습니다( Arts, 2010 ).

유엔아동권리협약(UNCRC)은 또한 장애 아동, 난민 아동, 소수자 공동체 아동 등 특정 아동 집단의 요구를 충족하는 것의 중요성을 강조합니다. 이는 장애인권리협약(CRPD)과도 상충됩니다.장애 아동의 교육권을 강조하는 7 항과 아동 권리 위원회8 및 원주민 권리에 관한 유엔 선언9. 원주민 아동의 권리에 주목합니다. 이러한 프레임워크는 모든 아동의 다양한 요구를 반영하는 포용적이고 공평한 교육 시스템의 필요성을 강조합니다. 그러나 이를 실제로 달성하는 것은 형식주의나 특정 집단의 배제와 같은 어려움에 직면하는 경우가 많으며, AI로 인해 더욱 복잡해집니다.

교육받을 권리

AI 시스템은 종종 아동의 교육권(제28조 및 제29조)을 다루는 수단으로 제안되는데, 특히 경험이 있거나 자격을 갖춘 교사가 없거나 너무 적은 경우에 그렇습니다. 교사가 없는 상황에서 AI 시스템을 사용하면 제한된 기간 동안(컴퓨터가 제대로 작동하지 않아 선반에 놓일 때까지) 일부 학생에게 어느 정도 지원을 제공할 수 있고 정책 입안자들이 문제를 해결하고 있다고 주장할 수 있지만, 교사 부족이라는 근본적인 문제는 해결하지 못합니다. 사실, AI에 대한 지출은 교사, 교사 교육, 학교 등 인적 자본에 대한 투자를 방해합니다. 어쨌든 앞서 언급했듯이 모든 아동이 받을 자격이 있는 고품질 교육을 제공할 수 있는 AI 시스템이 거의 없다는 증거가 있습니다(아동이 어떤 교육이든 받을 권리가 아니라 고품질 교육을 받을 권리는 2000년 유네스코 다카 행동 계획에서 처음 제시되었습니다).10 교육 분야에서 AI 시스템을 사용하는 것이 어떻게 그 순간의 개별 어린이의 교육 경험을 형성하는 데 영향을 미칠 뿐만 아니라 신경학적, 인지적, 정서적, 사회적 발달과 미래 삶에도 영향을 미칠 수 있는지에 대한 이해가 부족합니다(예: 음성으로 작동하는 도구와의 상호 작용이 어린이의 말하기, 의사소통 및 사회화 방식에 어떤 영향을 미칠까요?).11

차별로부터 보호받을 권리

차별받지 않을 권리(제2조)는 교육을 포함한 아동 삶의 모든 측면에 적용되는 기본 원칙입니다. 따라서 교육에 사용되는 AI 시스템은 수명 주기 전반에 걸쳐 비차별적이고 공정하며 포용적으로 설계되어야 합니다. 그러나 고정관념, 역사적 불평등, 편향된 데이터, 차별적인 알고리즘 등으로 인한 AI 시스템의 편견은 차별을 영속시킬 수 있습니다( Baker and Hawn, 2022 ). 예를 들어, 한 언어에서 성 중립적인 용어를 사용하는 AI 시스템은 종종 다른 언어에서는 성 차별적인 용어로 번역하여 기존의 성 불평등을 반영하고 강화합니다.

교육 분야에서 AI 시스템 활용은 형평성과 접근성에 대한 의문을 제기합니다. AI 시스템은 일부 아동에게 도움이 될 수 있지만, 기존의 불평등을 심화시킬 수도 있습니다. 예를 들어, 장애 인식에 따라 학생을 분류하는 AI 시스템은 배제와 낙인으로 이어질 수 있습니다. 마찬가지로, 사회경제적으로 취약한 환경의 아동은 필요한 기술과 인터넷 인프라에 대한 접근성이 부족하여 더욱 소외될 수 있습니다. 디지털 기술을 이용할 수 있는 사람과 그렇지 못한 사람 간의 이러한 디지털 격차는 교육에 대한 평등한 접근이라는 원칙을 훼손하며, 모든 아동이 기술 발전의 혜택을 누릴 수 있도록 보장하는 정책의 필요성을 강조합니다.

하지만 AI 덕분에 상황은 더욱 혼란스러워질 가능성이 높습니다. 가까운 미래에 디지털 격차가 역전될 수도 있습니다. 부유한 가정의 아이들은 인간 교사와 교육에서 인간 대 인간 상호작용의 모든 이점(견고하고 입증된 교육법 포함)을 누릴 수 있는 반면, 소외된 가정의 아이들은 기계의 가르침, 즉 교수법, 개별 학습, 그리고 화면 기반 학습에 만족해야 합니다. 이미 유수 유료 학교들은 디지털 기술이 아닌 교사의 자질을 홍보하는 경우가 많습니다.

인간 존엄성에 대한 권리

인간 존엄성에 대한 권리는 다른 많은 권리의 기초가 됩니다.AI와 교육의 맥락에서 이는 교육, 평가, 인증과 같은 업무가 아동의 존엄성을 침해하지 않는다는 것이 입증되지 않는 한 AI 시스템에 위임되어서는 안 된다는 것을 의미합니다(제28조).이러한 높은 기준이 달성되더라도 인간 교사는 아동의 정서적, 심리적 요구를 이해하고 대응할 수 있는 능력이 더 뛰어나므로 이러한 과정의 중심에 남아야 합니다.어쩌면 일부 외관에도 불구하고 AI 시스템은 인간 교사가 교실에 가져오는 공감과 직관이 부족합니다( Bender and Hanna, 2025 ).따라서 AI 시스템이 어느 정도 지원을 제공할 수는 있지만 긍정적이고 포용적인 학습 환경을 조성하는 데 필수적인 인간적 연결을 대체할 수는 없습니다.중요한 교육적 결정을 AI 시스템에 위임하면 아동의 존엄성을 훼손하고 고유한 요구와 잠재력을 가진 개인으로 대우하기보다는 데이터 포인트로 전락할 위험이 있습니다.

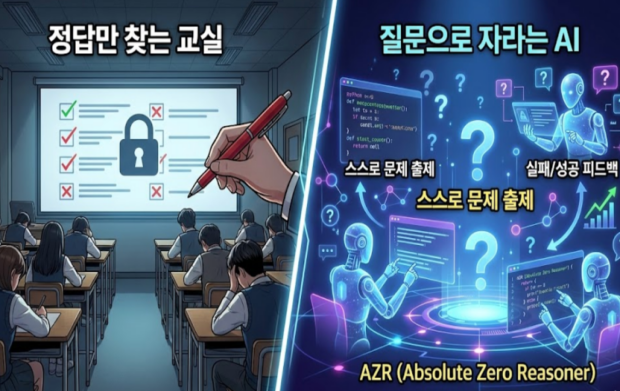

자율권

인간 존엄성에 대한 권리는 자율권에 대한 권리와 밀접하게 연결되어 있습니다(예: 제12조).교육을 위해 설계된 AI 시스템은 일반적으로 어린이가 무엇을 언제 어떻게 배워야 하는지 지시합니다(이것이 자주 홍보되는 AI 기반 ‘개인화된’ 경로입니다).그러나 이는 어린이의 주체성, 즉 학습에서 개별적인 선택을 할 수 있는 권리를 훼손합니다.어떤 사람들은 교사가 항상 결정을 내리고 어린이는 시키는 대로 한다고 주장할 수도 있습니다.그러나 차이점은 AI 시스템과 달리 교사는 개별 어린이, 강점과 약점, 관심사와 열망, 친구 및 가족 배경에 대한 실제 지식을 기반으로 결정을 내리는 반면 AI 시스템은 평균을 기반으로 결정을 내린다는 것입니다.어쨌든 교사는 비교적 적은 수의 어린이(일반적인 학급에서 약 30~40명)와 함께 일하는 반면 단일 AI 시스템은 수천 명에게 영향을 미칠 수 있습니다( Holmes, 2023 ).

또한, AI 기반 의사결정에 이의를 제기하고 이의를 제기할 권리(EU AI법 제69조에 예시됨)는 매우 중요하며, AI 기반 조작 및 프로파일링으로부터 배제될 권리 또한 마찬가지입니다. 그러나 이러한 권리는 대부분 열망의 영역에 머물러 있으며 실제로 실현되는 경우는 드뭅니다. 어떤 경우든 교육 분야에서 AI를 활용하는 것은 데이터 기반 의사결정의 정확성과 공정성에 대한 우려를 불러일으킵니다. 예를 들어, AI 시스템은 주로 과거 데이터를 사용하여 학습 경로를 결정하고 학습 결과를 예측하는데, 이는 편견과 불평등을 지속시킬 수 있습니다. 이러한 시스템을 훈련하는 데 사용되는 데이터는 거의 항상 과거의 차별과 불평등을 반영하며, 이로 인해 AI 시스템은 이러한 편견을 복제하고 증폭시켜 특정 학생 집단에게 불공정한 결과를 초래합니다.

동시에 어린이와 부모는 AI 시스템이 결정을 내리는 방법을 이해할 권리가 있어야 하며 필요한 경우 해당 결정에 이의를 제기할 수 있어야 합니다( Holmes et al., 2022 ). 어떤 맥락에서는 부모도 자녀의 교육에서 AI 시스템 사용을 거부할 권리가 있어 AI 지원 조작, 개인화된 프로파일링 및 예측을 피해 없이 피할 수 있습니다. 그러나 이러한 권리는 실제로 거의 지켜지지 않습니다. 많은 AI 시스템의 독점적 특성으로 인해 이러한 권리를 달성하기 어려운 반면 AI 맥락에서 동의 문제는 여전히 복잡합니다. 예를 들어, 학교에서 커리큘럼의 일부로 AI 시스템 사용을 요구할 수 있으므로 부모와 자녀가 거부할 여지가 거의 없습니다. 이는 동의를 얻는 방법과 동의가 진정으로 정보에 기반하고 자발적인지에 대한 중요한 질문을 제기합니다. 어린이와 부모가 동의를 보류하거나 철회할 권리가 있는지 확인하는 것은 자율성을 보호하는 데 필수적입니다.

청문받을 권리

의견의 청취권은 UNCRC의 초석(제12조)으로, 아동이 자신에게 영향을 미치는 결정에 참여하는 것의 중요성을 강조합니다( Lundy et al., 2022 ). 따라서 아동은 교육에서 AI 사용과 같은 문제에 대한 견해를 표현할 기회를 가져야 하며, 이러한 견해는 연령과 성숙도에 따라 적절한 가중치를 부여받아야 합니다. 그러나 실제로 아동의 목소리는 데이터 기반 기술의 가정된 객관성에 의해 대체되는 경우가 많습니다. 예를 들어, 학생의 행동과 성과를 모니터링하고 분석하는 AI 시스템은 아동이 자신의 관점과 경험을 표현할 권리를 무시할 수 있습니다. 한편, 이러한 시스템에서 생성된 데이터는 종종 아동의 주관적인 목소리보다 더 권위 있는 것으로 취급되어 아동이 아닌 기술이 ‘권리’를 행사하는 상황이 발생합니다.

개인정보 보호권

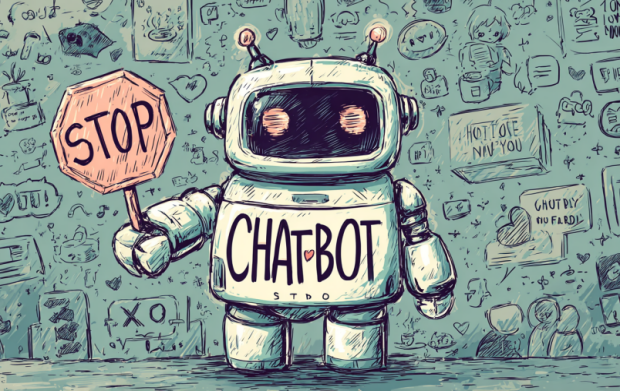

아동의 개인정보 보호(제16조)는 AI 시스템의 침습적 데이터 활용으로 인해 점점 더 위협받고 있습니다. 데이터는 사용자 상호작용을 통해 생성된 데이터 포인트를 자동적이고 지속적으로 수집, 집계, 분석하고 활용하는 머신러닝의 핵심입니다. 이러한 데이터는 침습적일 수 있으며, 전방위적인 효과를 초래하여 개인의 행동을 변화시킬 수 있습니다. 또한, AI가 학생을 모니터링하는 방식은 인간 교사의 개인적이고 일시적인 접근 방식에 비해 더 장기적이고 상업적입니다. 그러나 데이터 보호법이 존재함에도 불구하고, 개인정보 수집 및 오용으로부터 아동을 적절하게 보호하지 못하는 경우가 많습니다. 교육에 사용되는 AI 시스템은 학생들의 행동, 성과, 심지어 감정에 대한 정보를 포함하여 학생에 대한 방대한 양의 데이터를 수집하는 경우가 많습니다. 이러한 데이터는 일반적으로 상업적 개발자에 의해 저장되고 분석되므로, 데이터의 사용 방식과 접근 권한에 대한 우려가 제기됩니다. 개인정보 보호권은 보호권( Čulo Margaletić and Preložnjak, 2023 )일 뿐만 아니라 표현의 자유 및 집회의 자유와 같은 다른 권리 행사에 필수적인 권한 부여권이기도 합니다. 따라서 아동의 데이터를 비공개로 유지하고 보호하며 윤리적으로 사용하는 것이 매우 중요합니다.

경제적 착취로부터 보호받을 권리

상업용 AI 개발자에 의한 아동 데이터 착취는 또한 중대한 윤리적, 법적 문제를 제기합니다(32조). 데이터 보호법은 이러한 착취를 방지하는 것을 목표로 하지만 집행은 여전히 약하고, 몇몇 대기업에 권력이 집중되어 문제가 악화됩니다( Bologa, 2023 ). 예를 들어, 아동이 AI 시스템과 상호 작용하여 생성된 데이터(클릭, 타이핑, 그리기)는 시스템 소유자가 추출합니다(교육 분야의 AI 시스템의 대다수는 상업적이고 독점적입니다). 이를 사용하여 시스템을 훈련하고 개선한 후 더 많은 학교에 판매하여 개발자에게 추가 수익을 창출합니다. 아동, 부모, 학교는 데이터가 어떻게 사용되는지 또는 누가 이로부터 이익을 얻는지 거의 통제할 수 없습니다. 따라서 중요한 의미에서 이러한 AI 시스템을 사용하는 아동은 상업 조직을 위해 무급 노동으로 일하고 있으며, 따라서 아동을 상품으로 취급하고 상업적 착취로부터 보호받을 권리를 훼손합니다.

교육 리더십의 역할

교육 리더십은 항상 자신이 돌보는 어린이의 인권을 보호하는 책임을 맡아왔습니다.이 역할은 AI의 보편화가 증가함에 따라 더욱 어려워졌습니다( Fullan et al., 2024 ).그럼에도 불구하고 학교 리더(교장, 감독관, 정책 입안자 등)는 교육에서 AI를 도입하는 것이 UNCRC 및 관련 글로벌 협약의 원칙과 완전히 일치하도록 하는 주요 보증인 역할을 해야 합니다( Michopoulou and Gan, 2025 ).다시 말해, 교육 리더는 AI 시스템을 교실이나 기타 교육적 맥락에 허용하기 전에 마케팅에 현혹되지 않도록 예방 원칙을 채택해야 합니다.특히 개발자의 상업적, 투기적 주장보다 어린이의 복지를 우선시하고 어린이와 부모의 목소리를 들어야 합니다. 그들은 위에서 언급된, 비록 숨겨져 있지만 중요한 위험 요소들과 대비하여 AI의 추정되고 논란의 여지가 많은 ‘편익’을 적극적으로 검토해야 하며, 고려 중인 AI 시스템의 안전성과 효과성에 대한 고품질 증거를 요구해야 합니다. 또한, AI가 차별을 영속화하거나 경제적 착취로 이어지지 않도록 하는 명확한 정책을 수립하는 동시에 권리 기반 규제를 요구해야 합니다. 마지막으로, 아동의 양질의 교육을 받을 권리를 보장하기 위해, 모든 아동 교육의 중심에 인간 교사가 있도록 보장해야 합니다.

결론

책임감 있게 개발된다면 AI 시스템은 교육을 의미 있는 방식으로 향상시킬 잠재력을 가지고 있으며, 포용성, 참여, 학습 등을 지원할 수 있다는 것이 일반적인 믿음입니다. 그러나 반복될 위험을 무릅쓰고 말하자면, AI가 실제로 무엇을 하거나 할 수 있는지에 대한 독립적인 증거는 제한적이거나 아예 없습니다. 실제로 AI의 잠재력에 대한 주장은 공허하거나(거의 모든 것에 ‘잠재력’이 있을 수 있음) 완전히 추측에 불과하며, 업계와 기술 전문가들의 주장에서 무비판적으로 도출된 것입니다. 특히, 현대 AI 시스템(특히 ChatGPT와 같은 LLM 챗봇)이 어린이의 인지 발달, 행위 능력, 그리고 비판적 역량에 어떤 영향을 미치는지 알기에는 아직 너무 이릅니다. 따라서 근거 없는 기술을 교실에 구현하여 어린이를 대상으로 무심코 실험하기보다는, AI 시스템이 교육 환경에 도입되었을 때 실제로 어떤 일이 일어나는지 면밀히 조사하는 훨씬 더 많은 시간과 훨씬 더 엄격한 윤리적 연구가 필요합니다. 다시 말해, 아동의 권리가 근본적이라고 믿는 우리는 AI의 ‘잠재력’에 대한 주장에 강력하게 이의를 제기하고, 높은 품질의 증거와 권리 기반 규제를 요구해야 합니다. 이는 교육용으로 설계된 AI 시스템의 향후 개발을 안내하고(시스템이 윤리적이고 책임감 있으며 양질의 교육을 제공하고 아동의 권리를 존중하는지 확인하기 위함) 이미 입증된 위험과 아직 입증되지 않은 위험을 완화하기 위한 것입니다.

요점은, 교육 분야에서 AI 시스템의 효과성이나 안전성에 대한 증거는 부족하지만, 이러한 시스템이 아동의 존엄성, 자율성, 발언권, 그리고 사생활에 상당한 위험을 초래한다는 증거가 점점 더 많아지고 있다는 것입니다. 또한 이러한 시스템은 차별과 착취로부터 보호받을 아동의 권리를 침해합니다. 유엔아동권리협약(UNCRC)은 아동 권리를 보호하기 위한 핵심 도구이지만, 미약한 집행 메커니즘, 다양한 사회·경제적 맥락의 복잡성, AI 시스템이 아동의 권리를 점점 더 위협하는 숨겨진 방식, 그리고 권위 있는 직책에 있는 너무 많은 사람들이 믿고 있는 근거 없는 믿음과 잘못된 정보 등으로 인해 그 효과는 제한적입니다.

요약하자면, AI 시스템이 교육 전반에 걸쳐 더욱 광범위하게 구현되기 전에 (늦었지만 행동하기에 너무 늦지는 않았습니다), 정책 입안자, 학교 지도부, 교육자, 그리고 개발자들은 기술의 입증되지 않고, 추정되며, 논란의 여지가 많은 ‘이점’보다 아동의 권리와 복지를 우선시해야 합니다. 이를 통해 교육에 사용되는 모든 AI 시스템이 아동 권리 원칙에 완전히 부합하도록 해야 합니다. 그렇게 해야만 우리는 진정으로 아동에게 힘을 실어주고 존중하는 교육 환경을 조성할 수 있습니다.

저자 기여

WH: 개념화, 글쓰기 – 검토 및 편집, 글쓰기 – 초안.

자금 조달

저자는 이 논문의 연구 및/또는 출판을 위해 어떠한 재정적 지원도 받지 않았음을 선언합니다.

감사의 말

저자는 편집자 함디 아도우(Hamdi Addow)의 친절한 지도와 지원에 감사드리고자 합니다. 또한 본 논문에 제시된 많은 아이디어의 토대가 된 초기 논의를 진행해 주신 유럽 평의회(Council of Europe) 동료들께도 감사를 표합니다.

이해 상충

저자는 이 연구가 이해 상충의 가능성이 있는 상업적 또는 재정적 관계가 없는 상태에서 수행되었다고 선언합니다.

생성 AI에 대한 진술

저자는 이 원고를 작성하는 데 Gen AI가 사용되지 않았다고 선언합니다.

본 논문의 그림과 함께 제공된 모든 대체 텍스트(alt text)는 Frontiers에서 인공지능의 지원을 받아 생성한 것이며, 가능한 한 저자의 검토를 포함하여 정확성을 보장하기 위해 합리적인 노력을 기울였습니다. 문제가 발견되면 저희에게 연락해 주시기 바랍니다.

출판사 참고사항

본 기사에 표현된 모든 주장은 전적으로 저자의 것이며, 저자의 소속 기관이나 출판사, 편집자, 검토자의 주장을 반드시 대변하는 것은 아닙니다. 본 기사에서 평가된 제품이나 제조업체의 주장은 출판사에 의해 보장되거나 지지되는 것이 아닙니다.

각주

- https://www.europarl.europa.eu/doceo/document/TA-9-2024-0138-FNL-COR01_EN.pdf

- https://unesdoc.unesco.org/ark:/48223/pf0000381137

- https://www.oecd-ilibrary.org/science-and-technology/the-potential-impact-of-artificial-intelligence-on-equity-and-inclusion-in-education_15df715b-en

- https://www.unicef.org/globalinsight/media/2356/file/UNICEF-Global-Insight-policy-guidance-AI-children-2.0-2021.pdf.pdf

- https://www.un.org/en/about-us/universal-declaration-of-human-rights

- https://www.ohchr.org/en/instruments-mechanisms/instruments/convention-rights-child

- https://social.desa.un.org/issues/disability/crpd/convention-on-the-rights-of-persons-with-disabilities-crpd

- https://www.ohchr.org/en/treaty-bodies/crc

- https://www.ohchr.org/en/indigenous-peoples/un-declaration-rights-indigenous-peoples

- https://www.right-to-education.org/sites/right-to-education.org/files/resource attachments/Dakar_Framework_for_Action_2000_en.pdf

- https://www.unicef.org/innocenti/reports/policy-guidance-ai-children

References

Arts, K. (2010). Coming of age in a world of diversity? An assessment of the UN convention on the rights of the child. Hague, The Netherlands: International Institute of Social Studies.

Google Scholar

Baker, R. S., and Hawn, A. (2022). Algorithmic bias in education. Int. J. Artif. Intell. Educ. 32, 1052–1092. doi: 10.1007/s40593-021-00285-9

Crossref Full Text | Google Scholar

Bender, E. M., and Hanna, A. (2025). The AI con: How to fight big tech’s hype and create the future we want. London: The Bodley Head.

Google Scholar

Bologa, A., (2023). Fifty shades of GDPR privacy: the good, the bad, and the enforcement. CEPA. Available online at: https://cepa.org/article/fifty-shades-of-gdpr-privacy-the-good-the-bad-and-the-enforcement/ (Accessed June 29, 2025).

Google Scholar

Čulo Margaletić, A., and Preložnjak, B. (2023). Children’s right to privacy in the digital age. J. Int. Eur Law Econ. Mark. Integr. 10, 81–100. doi: 10.22598/iele.2023.10.2.4

Crossref Full Text | Google Scholar

Davies, H. C., Eynon, R., and Salveson, C. (2021). The mobilisation of AI in education: a Bourdieusean field analysis. Sociology 55, 539–560. doi: 10.1177/0038038520967888

Crossref Full Text | Google Scholar

Fullan, M., Azorín, C., Harris, A., and Jones, M. (2024). Artificial intelligence and school leadership: challenges, opportunities and implications. Schl Leadersh. Manage. 44, 339–346. doi: 10.1080/13632434.2023.2246856

Crossref Full Text | Google Scholar

Holmes, W. (2023). The unintended consequences of artificial intelligence and education. Brussels, Belgium: Education International Research.

Google Scholar

Holmes, W., Persson, J., Chounta, I.-A., Wasson, B., and Dimitrova, V. (2022). Artificial intelligence and education a critical view through the Lens of human rights, democracy and the rule of law. Strasbourg, France: Council of Europe.

Google Scholar

Lundy, L., Murray, C., Smith, K., and Ward, C. (2022). Young children’s right to be heard on the quality of their education: addressing potential misunderstandings in the context of early childhood education. Br. Educ. Res. J. 1, 1–15. doi: 10.1002/berj.3968

Crossref Full Text | Google Scholar

Michopoulou, K., and Gan, J. K. C. (2025). Ethical leadership in AI-enabled schools: navigating human rights, equity, and justice in education. Eur. J. Educ. Pedagogy 6, 24–33. doi: 10.24018/ejedu.2025.6.5.988

Crossref Full Text | Google Scholar

OECD,. (2023). Generative AI in the classroom: From hype to reality? Available online at: https://one.oecd.org/document/EDU/EDPC(2023)11/en/pdf

Google Scholar

Seldon, A., and Abidoye, O. (2018). The fourth education revolution: Will artificial intelligence liberate or infantilise humanity. Buckingham: The University of Buckingham Press.

Google Scholar

Keywords: Artificial Intelligence, education, child rights, human rights, well-being

Citation: Holmes W (2025) AI, education, and children’s rights. Front. Educ. 10:1656736. doi: 10.3389/feduc.2025.1656736

Received: 30 June 2025; Accepted: 14 October 2025;

Published: 25 November 2025.

Edited by:

Hamdi Addow, United Nations Educational, Scientific and Cultural Organization, France

Reviewed by:

Linda W. Friedman, Baruch College (CUNY), United States

Andreea Dragomir, Lucian Blaga University of Sibiu, Romania

Copyright © 2025 Holmes. This is an open-access article distributed under the terms of the Creative Commons Attribution License (CC BY). The use, distribution or reproduction in other forums is permitted, provided the original author(s) and the copyright owner(s) are credited and that the original publication in this journal is cited, in accordance with accepted academic practice. No use, distribution or reproduction is permitted which does not comply with these terms.

*Correspondence: Wayne Holmes, wayne.holmes@ucl.ac.uk

Disclaimer: All claims expressed in this article are solely those of the authors and do not necessarily represent those of their affiliated organizations, or those of the publisher, the editors and the reviewers. Any product that may be evaluated in this article or claim that may be made by its manufacturer is not guaranteed or endorsed by the publisher.

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.